Kategoria: Konferencja

Rok: 2024

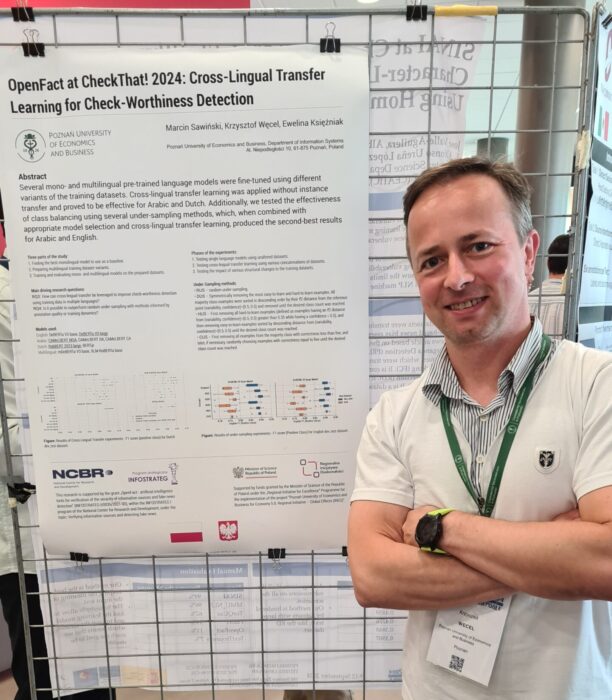

Tytuł wystąpienia: OpenFact at CheckThat! 2024: Cross-Lingual Transfer Learning for Check-Worthiness Detection

Organizator: University of Grenoble Alps

Termin: 9-12 września 2024

Link do Bazy Wiedzy: Baza Wiedzy

CLEF 2024: Conference and Labs of the Evaluation Forum

Krzysztof Węcel

Obszarem naszego zainteresowania jest określanie, czy poddana treść tekstowa wymaga sprawdzenia, tzn. czy powinniśmy podejść do niej z dystansem i zweryfikować w zewnętrznych źródłach. Na przykład zdania „Zupa pomidorowa jest lepsza niż ogórkowa” lub „Trójkąt ma trzy kąty” nie wymagają sprawdzenia. Natomiast w przypadku stwierdzenia „W Polsce mamy więcej dentystów niż chirurgów” konieczne jest poszukanie źródeł.

Klasyfikacja treści na wymagające i niewymagające sprawdzenia ma bardzo duże znaczenie praktyczne. Weryfikacją informacji zajmują się agencje fact-checkingowe, które mogą przerobić niewielką część treści pojawiających się w sieci. Ważne jest zatem, aby mogły skupiać się tylko na najistotniejszych wiadomościach. Z zarządczego punktu widzenia mówimy o zmniejszeniu przesytu informacyjnego.

Do rozwiązania problemu klasyfikacji tekstu proponujemy zastosowanie modeli językowych. Każdy model przed zastosowaniem należy wytrenować lub dostroić do specyfiki zadania. Niezbędne jest zatem zgromadzenie oraz przygotowanie odpowiednich danych. W naszym artykule poruszyliśmy dwa ważne aspekty zbioru danych: wielojęzyczność oraz jakość.

Dane mogą pochodzić z jednego języka i służyć do trenowania modelu jednojęzycznego. Nasze badania wskazują, że można osiągnąć dokładniejszą klasyfikację, trenując model wielojęzyczny na wymieszanych danych w wielu językach. Prawdopodobnie wynika to z szerszego zakresu danych, ich bogatszego kontekstu i zróżnicowanych struktur językowych. Co ciekawe, nie jest konieczne, aby języki używane do trenowania były do siebie podobne. Na przykład, bardzo dobre wyniki udało nam się osiągnąć, łącząc dane w języku niderlandzkim i arabskim.

Równie istotnym aspektem podczas trenowania modeli jest odpowiednie zbalansowanie zbioru danych. Chodzi o to, aby liczba przykładów pozytywnych i negatywnych była zbliżona. Zbyt duża liczba przykładów z jednej klasy może prowadzić do zaburzenia wyników i obniżenia jakości predykcji. Dlatego stosuje się technikę podpróbkowania (undersampling), która polega na wyborze wszystkich przypadków klasy niedoreprezentowanej oraz dolosowaniu takiej samej liczby przykładów z klasy liczniejszej. Przykłady można wybierać losowo, jednak nasze badania wskazują, że bardziej efektywnym podejściem jest selekcja przypadków według ich jakości. To pozwala na zwiększenie dokładności modeli i ich lepsze dopasowanie do zadań klasyfikacyjnych.

W podejmowaniu decyzji ważne jest, aby opierać się na prawdziwych, zweryfikowanych informacjach wysokiej jakości.

Współautorzy: Marcin Sawiński, Ewelina Księżniak